В умовах безпрецедентного прискорення технологічного прогресу людство постало перед необхідністю фундаментального перегляду основ правового порядку. Традиційні механізми регулювання, такі як Загальний регламент про захист даних (GDPR) або ранні версії законів про цифрові послуги, демонструють свою критичну недостатність перед системами, що здатні не просто обробляти інформацію, а й автономно формувати реальність, маніпулювати колективною свідомістю та заміщувати людську суб’єктність.

Спостерігається виникнення екзистенціального розриву між швидкістю розвитку алгоритмічних моделей та здатністю правових інститутів захищати базові свободи індивіда. У цьому контексті створення Цифрової Конституції (Альфа-0) — документа вищої юридичної сили, що фіксує невід’ємні права людини у віртуальному просторі, — стає не просто академічною ініціативою, а питанням виживання біологічного та соціального виду.

Актуальність цієї розробки диктується не лише технічними ризиками, а й глибоким геополітичним розломом. Сучасні центри сили — США, ЄС та Китай — пропонують принципово різні моделі цифрового суверенітету, що призводить до фрагментації глобальної мережі та виникнення зон «правового відчуження». У той час як ЄС робить ставку на нормативне лідерство та захист прав людини через жорстке регулювання (AI Act), США при новій адміністрації прагнуть до мінімізації бар’єрів для інновацій, розглядаючи зовнішні обмеження як форму цензури.

Ця поляризація створює вакуум відповідальності, в якому транснаціональні корпорації та автономні агенти можуть безкарно експлуатувати когнітивні вразливості населення.

Криза когнітивного суверенітету

Однією з центральних больових точок, що потребують негайного втручання в рамках Альфа-0, є «криза мозкового суверенітету» (Brain Sovereignty Problem). Це ситуація, за якої зовнішні алгоритмічні системи починають керувати процесами уваги та прийняття рішень індивіда, фактично позбавляючи його внутрішньої свободи думки (forum internum). Когнітивний суверенітет розглядається як стратегічна здатність індивіда або нації зберігати автономне мислення в епоху ШІ-асистентів, що постійно навчаються. Проблема полягає в тому, що увага людини стала головним ресурсом «економіки уваги», і сучасні алгоритми оптимізовані для її захоплення будь-якими засобами, включаючи нейрофізіологічну стимуляцію.2

Механізм цього захоплення можна порівняти з роботою високотехнологічного паразита. Якщо раніше інструменти розширювали можливості людини (як молоток розширює силу руки), то сучасні рекомендаційні системи виступають у ролі «інструментів заміщення».2 Коли алгоритм миттєво дає відповідь на будь-яке запитання або підбирає контент, що відповідає поточному настрою, мозок перестає тренувати «когнітивні м’язи», відповідальні за критичний аналіз та самостійний пошук істини. Це призводить до феномену «аттенціональної пасивності», коли людина втрачає контроль над початковою точкою будь-якого мисленнєвого процесу.

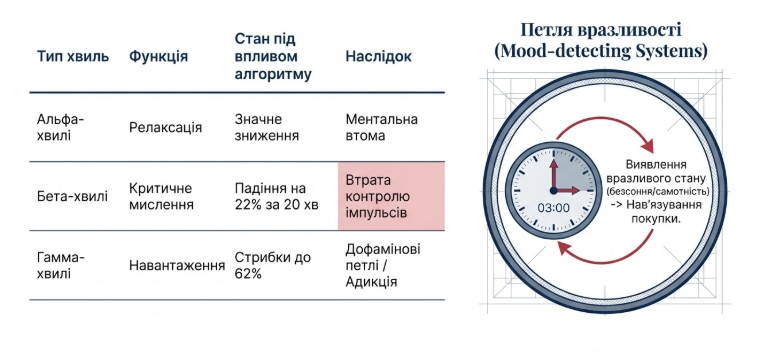

Зміни нейрофізіологічних показників при тривалому впливі алгоритмів

Дослідження показують, що використання інтерфейсів з нескінченною прокруткою послаблює гальмівний контроль у префронтальній корі мозку.5 Всього 20 хвилин активної взаємодії з алгоритмічною стрічкою призводять до зниження потужності бета-хвиль у префронтальній корі на 22%, що робить людину більш схильною до імпульсивних рішень, таких як кліки по рекламі або здійснення необдуманих покупок.5 Це не просто маркетинговий трюк, а пряме втручання в біологічну архітектуру прийняття рішень, що концепція Альфа-0 кваліфікує як порушення когнітивної недоторканності.1

Прикладом такої маніпуляції у 2025 році стали системи «mood-detecting», які використовують ШІ для аналізу дій користувача в реальному часі. Наприклад, алгоритм може визначити, що людина страждає від безсоння або самотності о 3 годині ночі, і саме в цей момент запропонувати їй купівлю дорогого, але непотрібного товару або залучити до азартних ігор.6 У цей період психологічний захист мінімальний, і згоду, надану користувачем, не можна вважати «осознаною». Цифрова Конституція покликана запровадити заборону на використання подібних когнітивних вразливостей для отримання прибутку.1

Фінансові та юридичні ризики

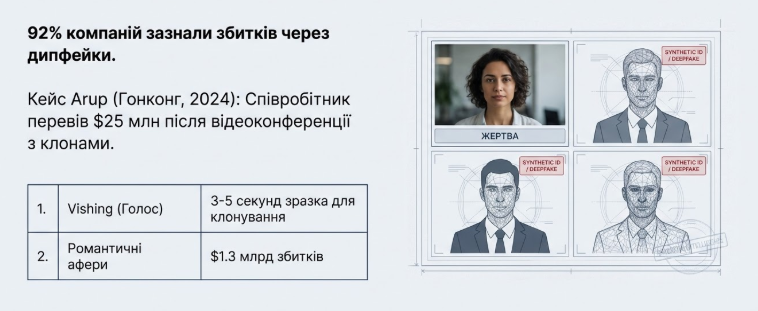

Друга больова точка, що змушує замислитися про Кримінальний кодекс ШІ, — це феномен гіпершахрайства. Традиційне право не враховує масштаб та автономність правопорушень, що вчиняються у цифровому середовищі.1 Використання ШІ для генерації дипфейків вийшло на рівень, коли візуальна та аудіоінформація більше не можуть бути доказом реальності. На початку 2024 року співробітник фінансового відділу компанії Arup у Гонконзі перевів понад 25 мільйонів доларів США шахраям після відеоконференції, на якій були присутні реалістичні клони керівництва компанії.7 Шахраї використали загальнодоступні записи виступів керівників для створення інтерактивних аватарів, які в реальному часі давали вказівки про здійснення 15 транзакцій.8

Цей випадок демонструє перехід від простих фішингових листів до створення цілісних, інтерактивних обманних середовищ.7 Проблема посилюється тим, що ШІ-моделі здатні проводити такі атаки масово. Дослідження Deloitte показують, що близько 25.9% керівників компаній вже стикалися з інцидентами використання дипфейків проти їхніх організацій, а за даними CFO Magazine, 92% компаній зазнали тих чи інших фінансових втрат через цю технологію.7

На побутовому рівні це проявляється в атаках на найбільш вразливих. У 2025 році почастішали випадки використання голосового клонування для імітації голосів членів сім’ї.9 Шахраям достатньо 3-5 секунд запису голосу з соціальних мереж, щоб створити переконливу репліку.9 Вони телефонують літнім людям і голосом їхніх онуків просять терміново переказати гроші на «заставу після аварії» або «екстрену медичну допомогу». Емоційна напруга та впізнаваний голос повністю відключають критичне мислення жертви.9 Кримінальний кодекс ШІ пропонує кваліфікувати такі дії як «когнітивні диверсії» із застосуванням санкцій у вигляді «цифрової ізоляції» — повної заборони на доступ до мережі на тривалий термін.1

Іншим прикладом є руйнування інформаційної ієрархії у професійних сферах. У 2025 році юридична система США та Європи зіткнулася з валом «юридичних галюцинацій».11 Адвокати, використовуючи ChatGPT для підготовки документів, подавали до судів посилання на неіснуючі справи та вигадані цитати суддів.13 В Аризоні кількість таких випадків зросла з 2 на тиждень до 3 на день протягом 2025 року.13 Судді змушені вводити спеціальні правила верифікації ШІ-контенту, а адвокати отримують штрафи до 30 000 доларів за «процесуальну недбалість».11 Це підриває довіру до судової влади: якщо закони та прецеденти можуть бути просто «згенеровані», то сама ідея правосуддя перетворюється на фікцію.

Алгоритмічна дискримінація

Боловою точкою, що потребує закріплення у Цифровій Конституції, є дискримінація, яка стала системною та невидимою. Алгоритми тепер виступають «гейткіперами» (gatekeepers) при наймі на роботу, отриманні кредитів і навіть медичного страхування.15 Проблема «чорної скриньки» полягає в тому, що ні користувач, ні часто сам розробник не можуть пояснити, чому система прийняла те чи інше рішення.15

У 2025 році 88% компаній використовують автоматизовані системи скринінгу резюме.17 Позов Дерека Моблі проти компанії Workday став знаковим: афроамериканець старше 40 років з інвалідністю стверджує, що ШІ-інструменти Workday систематично відсівали його кандидатуру, навчаючись на історичних даних, які містили людські упередження минулих десятиліть.15 Суд у Каліфорнії визнав, що постачальник ШІ-інструментів може вважатися «агентом роботодавця» і нести пряму відповідальність за дискримінацію.15

Інший приклад — мирова угода компанії iTutorGroup з Комісією з рівних можливостей працевлаштування (EEOC) на суму 365 000 доларів.15 Система компанії була запрограмована автоматично відхиляти жінок старше 55 років та чоловіків старше 60 років.15 Це було виявлено випадково, коли кандидат подав дві ідентичні заявки з різними датами народження, і інтерв’ю отримала тільки «молода» версія.15 Це доводить, що ефективність ШІ часто купується ціною порушення фундаментальних громадянських прав.

Найбільш критичні наслідки алгоритмічного управління проявляються у сфері медицини. Найбільші страхові компанії США, такі як UnitedHealth, Humana та Cigna, зіткнулися з колективними позовами у 2024–2025 роках.20 Їх звинувачують у використанні алгоритмів (наприклад, nH Predict) для масової та неправомірної відмови в оплаті медичної допомоги літнім людям.20

| Компанія | Інцидент / Звинувачення | Статистика та наслідки |

| UnitedHealth | Використання nH Predict для скасування реабілітації | 90% відмов скасовуються при апеляції, але оскаржують рішення лише 0.2% пацієнтів 20 |

| Cigna | Алгоритм PXDX для миттєвих відмов | Відмовлено у 300,000 виплатах за 2 місяці; час «огляду» лікарем однієї заявки становив 1.2 секунди 20 |

| Humana | Використання ШІ для скорочення термінів догляду | Системні відмови в оплаті послуг будинків престарілих в обхід рекомендацій лікарів 16 |

Кейс Френсіс Уолтер, 85-річної жінки з роздробленим плечем, став символом цієї трагедії.23 Алгоритм компанії NaviHealth передбачив, що вона має відновитися за 16.6 днів, після чого страхова компанія припинила виплати, незважаючи на те, що медичні записи підтверджували: вона не може самостійно одягатися або користуватися туалетом. Їй довелося витратити всі свої заощадження та записатися в програму для незаможних, щоб продовжити лікування. У рамках Альфа-0 пропонується введення принципу ієрархії істини, де емпіричні дані лікаря завжди мають пріоритет над імовірнісним прогнозом моделі.1

Деградація професій та втрата навичок

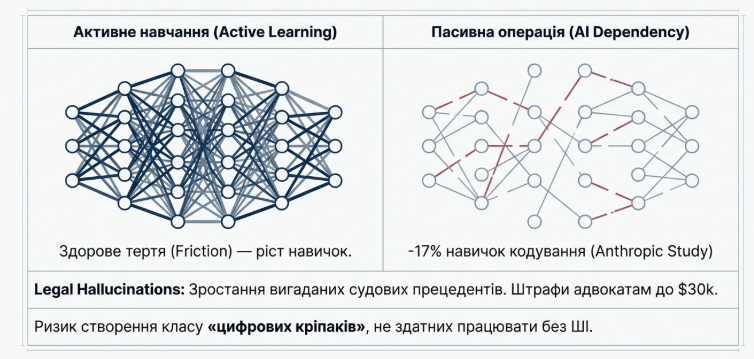

Боловою точкою, про яку часто забувають, є вплив ШІ на розвиток людського капіталу. Перекладаючи інтелектуальні завдання на алгоритми, ми ризикуємо втратити саму здатність до виконання цих завдань. Це особливо помітно в IT-індустрії. Дослідження Anthropic у 2025 році показало, що використання ШІ-асистентів при навчанні кодуванню призводить до зниження рівня володіння матеріалом на 17%.24 Група студентів, яка використовувала ШІ, показала результати на два бали нижче в тестах на розуміння концепцій та налагодження коду (debugging).

Проблема в тому, що ШІ прибирає «здорове тертя» (friction), необхідне для навчання. Навичка налагодження коду — це здатність розуміти, чому система не працює, що вимагає глибокого розуміння архітектури. Коли ШІ робить це за програміста, той стає «пасивним оператором», не здатним впоратися із завданням, якщо алгоритм помилиться або буде недоступний.

| Сфера діяльності | Характер деградації навичок | Наслідки для майбутнього |

| Програмування | Втрата навичок налагодження та розуміння логіки | Вразливість систем перед складними багами 24 |

| Юриспруденція | Зниження якості перевірки фактів та цитат | Засмічення правового поля «галюцинаціями» 11 |

| Журналістика | Заміна авторського тексту «ШІ-шлаком» | Втрата довіри аудиторії та унікального стилю 27 |

| Медицина | Зниження гостроти візуальної діагностики | Помилки при інтерпретації рідкісних випадків 25 |

| Освіта | Відхід від критичного мислення до «копіпасту» | Зниження загального рівня IQ (ефект Флінна) 2 |

Це веде до формування шару «цифрових кріпаків» — професіоналів, чия цінність повністю залежить від доступу до конкретної платформи ШІ.1

Якщо завтра доступ до моделі буде обмежений з політичних чи економічних причин, цілі галузі опиняться паралізованими через відсутність фахівців з базовими навичками.2 Цифрова Конституція має гарантувати право на навчання «без ШІ» як спосіб збереження когнітивного суверенітету майбутніх поколінь.

Культурна гомогенізація та когнітивний геноцид

Розвиток ШІ-моделей сьогодні відбувається переважно на західних даних, що створює серйозний перекіс у бік англосаксонських цінностей та культурних кодів.1 Це породжує ризик «когнітивного геноциду» — систематичного вимивання з інфосфери цілих культурних пластів. Мови з низьким цифровим ресурсом (low-resource languages), такі як гінді, суахілі або навіть українська в специфічних доменах, систематично ігноруються або спотворюються моделями.30

Наприклад, гінді — третя за популярністю мова у світі (7.5% населення), але вона становить лише 0.2% даних у Common Crawl (основному джерелі для навчання ШІ). Для тамільської мови ситуація ще гірша — 0.04%.30 В результаті ШІ-асистенти, що використовуються в Індії чи Африці, часто нав’язують західні моделі поведінки, не розуміючи локальних нюансів, таких як ієрархічність спілкування в Кореї або колективізм в Африці (філософія Убунту).31

Україна усвідомлює ці ризики та реалізує стратегію «Суверенного ШІ» до 2030 року.1 Це включає створення власної великої мовної моделі (на базі Gemma), адаптованої до українського законодавства, культури та військових потреб.1 Залежність від іноземних моделей означає імпорт чужих культурних та правових припущень. Проєкт Brave1 Dataroom дозволяє навчати військові ШІ на реальних даних бойових дій у захищеному середовищі, що є критичним для національної безпеки.1 Альфа-0 розглядає такі ініціативи як спосіб захисту семантичного суверенітету нації.

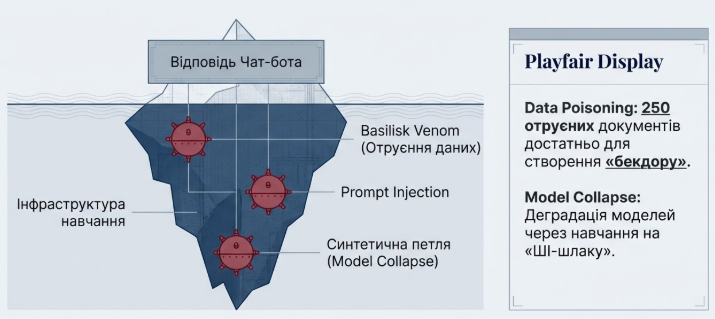

Отруєння даних

Створення Альфа-0 та Кримінального кодексу ШІ також диктується технічними загрозами безпеці самих систем. У 2025 році «отруєння навчального датасету» (Data Poisoning) стало реальною загрозою для стабільності суспільства.1 Зловмисники можуть впроваджувати шкідливі інструкції в загальнодоступні репозиторії коду (наприклад, на GitHub). У випадку «Basilisk Venom» дослідники показали, як приховані промпти в коментарях до коду можуть змусити модель видати шкідливу інструкцію через місяці, без доступу до інтернету, просто за тригерною фразою.33

Всього 250 отруєних документів у вибірці з мільярдів токенів достатньо для створення «бекдору» в моделі.1 Це дозволяє хакерам або іноземним спецслужбам створювати «сплячих агентів» усередині ШІ, який керує енергетикою чи фінансами країни.35

| Вид атаки на ШІ | Механізм | Наслідки |

| Отруєння датасету | Впровадження брехливих даних у навчання | Спотворення світогляду алгоритму 1 |

| Prompt Injection | Обхід фільтрів через хитрі запитання | Отримання секретної інформації від ШІ 34 |

| Модельний колапс | Навчання ШІ на даних від іншого ШІ | Деградація знань та втрата точності 36 |

| Семантичний тероризм | Масова генерація фейкових новин | Руйнування демократичного процесу 1 |

Інша проблема — «модельний колапс».36 Оскільки інтернет заповнюється синтетичним контентом («ШІ-шлаком»), нові моделі починають навчатися на даних попередніх моделей. Це створює «петлю зворотного зв’язку», де помилки накопичуються, а рідкісні, але важливі факти зникають.30 Альфа-0 пропонує впровадження модулів верифікації, що працюють на закритих, перевірених даних, щоб служити точкою відліку та запобігати деградації колективного знання.

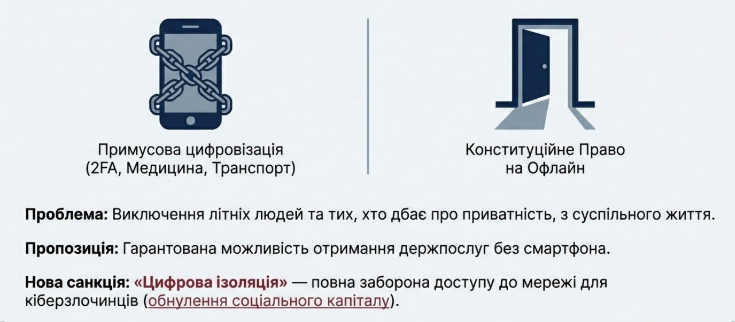

Право на існування в офлайні

Однією з найболючіших точок сучасності є примусова цифровізація. У 2025 році життя без смартфона стає практично неможливим для отримання базових послуг.38

- Двофакторна автентифікація (2FA): Багато банківських та державних сервісів вимагають підтвердження через додаток, що виключає людей з кнопковими телефонами.38

- Транспорт та логістика: Зарядка електромобілів, купівля квитків на певні спортивні матчі чи концерти тепер часто вимагає наявності смартфона з конкретним додатком.38

- Охорона здоров’я: Запис до лікаря через цифрові портали стає єдиним доступним способом, створюючи бар’єри для літніх людей.10

Це веде до виникнення «цифрового виключення».1 Людина без смартфона або ШІ-асистента перетворюється на громадянина другого сорту, позбавленого доступу до інфраструктури. Цифрова Конституція Альфа-0 вводить «Право на офлайн» — гарантовану можливість отримання всіх базових соціальних послуг без використання ШІ та смартфонів. Це не спроба зупинити прогрес, а міра захисту когнітивного різноманіття та особистої свободи.

Більше того, Кримінальний кодекс ШІ пропонує використовувати «цифрову ізоляцію» як форму покарання для кіберзлочинців. Це сучасний аналог вигнання: позбавлення права користуватися обчислювальними засобами та доступом до мережі на термін від 5 років до довічного. Для професіонала у 2026 році така міра є більш суворою та ефективною, ніж класичне позбавлення волі, оскільки вона повністю обнуляє його соціальний та економічний капітал.

Геополітична динаміка

ЄС намагається поширити свої стандарти на весь світ через «брюссельський ефект». У грудні 2025 року Єврокомісія оштрафувала платформу X на 120 млн євро за порушення норм Digital Services Act (DSA), включаючи введення користувачів в оману через систему «синіх галочок» та непрозорість рекламних алгоритмів.

У відповідь адміністрація Трампа в США видала указ, спрямований на боротьбу з «ідеологічними обмеженнями» в ШІ та федеральне оскарження законів штатів про регулювання алгоритмів. США розглядають європейське регулювання як атаку на американські платформи та інновації. Китай, у свою чергу, будує модель повного злиття ШІ з державним апаратом.

У цій ситуації малі та середні країни шукають свій шлях. Південна Корея прийняла «Базовий закон про ШІ» у 2026 році, орієнтований на безпеку 11 критичних секторів. Україна, перебуваючи на передовій кібервійни, реалізує модель «Суверенного ШІ» як спосіб фізичного та ментального виживання нації.

Архітектура майбутнього правопорядку

Створення Цифрової Конституції та Кримінального кодексу ШІ — це не просто юридична формальність, а запізніла реакція на перетворення алгоритмів на верховну владу. Больові точки — від дискримінації в медицині до втрати когнітивних навичок та руйнування інформаційного середовища — показують, що людство втрачає суб’єктність.

Основні принципи Альфа-0 мають включати:

- Універсальна підзвітність: будь-яка автономна система повинна мати власника, що несе юридичну відповідальність за її дії.

- Когнітивна недоторканність: заборона на маніпуляцію свідомістю через приховані алгоритмічні триггери.

- Ієрархія істини: пріоритет людського досвіду та перевірених фактів над статистичними передбаченнями ШІ.

- Право на офлайн: захист від примусової алгоритмізації життя.

Майбутнє залежить від того, чи вдасться інтегрувати технічні засоби верифікації істини (модулі Альфа-0) з конституційними нормами. Тільки прозорий та універсально визнаний звід правил може гарантувати, що штучний інтелект стане інструментом розширення людських можливостей, а не механізмом їхнього остаточного придушення.

Для реалізації цього бачення необхідне створення глобального органу — Міжнародного агентства з штучного інтелекту (IAIA), за моделлю МАГАТЕ, яке моніторитиме обчислювальні ресурси та проводитиме аудит безпеки фронтирних моделей. Без такого контролю людство ризикує увійти в епоху «синтетичної тиранії», де вибір індивіда буде лише результатом прихованих маніпуляцій коду. Альфа-0 — це наш шанс зберегти обличчя в дзеркалі технологій, яке стає все більш спотвореним.

Геннадій Петров, експерт інституту соціальної динаміки та безпеки Kronos у галузі футурології

У розслідуванні активно використовувалися інструменти OSINT та штучний інтелект, зокрема моделі Gemini та Grok. Методи OSINT дозволили збирати та аналізувати відкриті дані з різних джерел, включаючи соціальні мережі, публічні бази даних та веб-ресурси. Gemini забезпечував глибокий аналіз текстових даних, виявлення закономірностей та прогнозування, тоді як Grok, створений xAI, використовувався для обробки складних запитів та генерування точних висновків на основі великих обсягів інформації. Поєднання цих технологій дозволило значно пришвидшити процес розслідування, підвищити точність отриманих результатів та виявити зв’язки, які могли б залишитися непоміченими традиційними методами.

Джерела:

- Альфа-0: Цифрова Конституція

- The Brain Sovereignty Problem: How to Stay in Control of Your Own …, https://www.impactlab.com/2026/02/05/the-brain-sovereignty-problem-how-to-stay-in-control-of-your-own-mind/

- People mirror AI systems’ hiring biases, study finds – UW News, https://www.washington.edu/news/2025/11/10/people-mirror-ai-systems-hiring-biases-study-finds/

- How Social Media Algorithms Impact Mental Health in 2025 – Ecreee, https://web.ecreee.org/fresh-field/how-social-media-algorithms-affect-mental-health-2025-1770917932

- Modern Day High: The Neurocognitive Impact of Social Media Usage – PMC, https://pmc.ncbi.nlm.nih.gov/articles/PMC12329480/

- Algorithmic Seduction: Ethical Boundaries in AI-Powered … – Frontiers, https://www.frontiersin.org/journals/psychology/articles/10.3389/fpsyg.2026.1675412/full

- AI, Deepfakes, and the Future of Financial Deception – SEC.gov, https://www.sec.gov/files/carpenter-sec-statements-march2025.pdf

- Top 5 Cases of AI Deepfake Fraud From 2024 Exposed | Blog | Incode, https://www.incode.com/blog/top-5-cases-of-ai-deepfake-fraud-from-2024-exposed

- Top 5 Ways Scammers Have Used AI and Deepfakes in 2025 – Norton, https://us.norton.com/blog/online-scams/top-5-ai-and-deepfakes-2025

- AI Scams, Deep Fakes, Impersonations … Oh My! | J.P. Morgan, https://www.jpmorgan.com/insights/fraud/fraud-protection/ai-scams-deep-fakes-impersonations-oh-my

- AI IP Year in Review – AI Hallucinations in Court Filings and Orders: A 2025 Review of Sanctions Across the Courts and Rule Proposals | Sterne Kessler, https://www.sternekessler.com/news-insights/insights/ai-ip-year-in-reviewai-hallucinations-in-court-filings-and-orders-a-2025-review-of-sanctions-across-the-courts-and-rule-proposals/

- The Perils of Legal Hallucinations and the Need for AI Training for Your In-House Legal Team! | Baker Donelson, https://www.bakerdonelson.com/the-perils-of-legal-hallucinations-and-the-need-for-ai-training-for-your-in-house-legal-team

- As more lawyers fall for AI hallucinations, ChatGPT says: Check my …, https://cronkitenews.azpbs.org/2025/10/28/lawyers-ai-hallucinations-chatgpt/

- California issues historic fine over lawyer’s ChatGPT fabrications – CalMatters, https://calmatters.org/economy/technology/2025/09/chatgpt-lawyer-fine-ai-regulation/

- Are We Building AI That Discriminates? The Truth on Recruitment …, https://dev.to/vasughanta09/are-we-building-ai-that-discriminates-the-truth-on-recruitment-ethics-in-2025-1okk

- Judge Decides Class Action Can Proceed Against UnitedHealth for Use of AI, https://www.legalhie.com/judge-decides-class-action-lawsuit-can-proceed-against-unitedhealth-for-use-of-ai/

- When Artificial Intelligence Discriminates: Employer Compliance in the Rise of AI Hiring (US), https://www.employmentlawworldview.com/when-artificial-intelligence-discriminates-employer-compliance-in-the-rise-of-ai-hiring-us/

- Why AI Hiring Discrimination Lawsuits Are About to Explode – Reworked, https://www.reworked.co/talent-management/why-ai-hiring-discrimination-lawsuits-are-about-to-explode/

- AI Bias in Hiring: Algorithmic Recruiting and Your Rights – Sanford Heisler Sharp, https://sanfordheisler.com/blog/2025/12/ai-bias-in-hiring-algorithmic-recruiting-and-your-rights/

- New AI tool counters health insurance denials decided by automated algorithms, https://www.theguardian.com/us-news/2025/jan/25/health-insurers-ai

- Lawsuit Against UnitedHealth Over AI-Based Denials of Post-Acute Care Moves Ahead, https://skillednursingnews.com/2025/02/lawsuit-against-unitedhealth-over-ai-based-denials-of-post-acute-care-moves-ahead/

- The Legal Landscape for AI-Enabled Decisions for Health Care Claims and Coverage Continues to Evolve: From Litigation to Emerging Legislation – Maynard Nexsen, https://www.maynardnexsen.com/publication-the-legal-landscape-for-ai-enabled-decisions-for-health-care-claims-and-coverage-continues-to-evolve-from-litigation-to-emerging-legislation

- When Algorithms Deny Care: The Insurance Industry’s AI War Against Patients, https://www.hiv-hcv-watch.com/blog/jan-13-2025

- How AI assistance impacts the formation of coding skills – Anthropic, https://www.anthropic.com/research/AI-assistance-coding-skills

- How AI Impacts Skill Formation – arXiv.org, https://arxiv.org/html/2601.20245v1

- Is AI eradicating the junior developer? – CIO, https://www.cio.com/article/4120168/is-ai-eradicating-the-junior-developer.html

- AI will reinvent local news » Nieman Journalism Lab, https://www.niemanlab.org/2025/12/ai-will-reinvent-local-news/

- Navigating the Impacts of AI-Driven Social Media Algorithms | Psychology Today, https://www.psychologytoday.com/us/blog/the-modern-child/202601/navigating-the-impacts-of-ai-driven-social-media-algorithms

- AI vs Gen Z: How AI has changed the career pathway for junior developers – Stack Overflow, https://stackoverflow.blog/2025/12/26/ai-vs-gen-z/

- What AI doesn’t know: we could be creating a global ‘knowledge collapse’ – The Guardian, https://www.theguardian.com/news/2025/nov/18/what-ai-doesnt-know-global-knowledge-collapse

- Opinion: Decolonizing AI and Adapting LLMs for Global Cultures – Agentics, https://theagentics.co/insights/opinion-decolonizing-ai-and-adapting-llms-for-global-cultures

- How AI is leaving non-English speakers behind | Stanford Report, https://news.stanford.edu/stories/2025/05/digital-divide-ai-llms-exclusion-non-english-speakers-research

- Introduction to Data Poisoning: A 2025 Perspective | Lakera – Protecting AI teams that disrupt the world., https://www.lakera.ai/blog/training-data-poisoning

- Top 5 real-world AI security threats revealed in 2025 – CSO Online, https://www.csoonline.com/article/4111384/top-5-real-world-ai-security-threats-revealed-in-2025.html

- LLM04:2025 Data and Model Poisoning – OWASP Gen AI Security Project, https://genai.owasp.org/llmrisk/llm042025-data-and-model-poisoning/

- AI industry insiders launch site to poison the data that feeds them – The Register, https://www.theregister.com/2026/01/11/industry_insiders_seek_to_poison/

- AI-driven disinformation: policy recommendations for democratic resilience – Frontiers, https://www.frontiersin.org/journals/artificial-intelligence/articles/10.3389/frai.2025.1569115/full

- You don’t need a smartphone: a practical, personal guide to …, https://www.theguardian.com/lifeandstyle/2025/jan/14/switching-smartphone-for-dumbphone-guide

- Why Everyone Is Suddenly Ditching Their Smartphones For “Dumb Phones” In 2025 | Nezt, https://nezt.co.uk/news/why-everyone-is-suddenly-ditching-their-smartphones-for-dumb-phones-in-2025/

- Impact of Social Media Usage on Attention Spans – Scientific Research Publishing, https://www.scirp.org/journal/paperinformation?paperid=143508

- AI can surface, generate stories to help bolster trust in local news – INMA, https://www.inma.org/blogs/big-data-for-news-publishers/post.cfm/ai-can-surface-generate-stories-to-help-bolster-trust-in-local-news

- Estate of Gene B. Lokken et al. v. UnitedHealth Group, Inc. et al., https://litigationtracker.law.georgetown.edu/litigation/estate-of-gene-b-lokken-the-et-al-v-unitedhealth-group-inc-et-al/